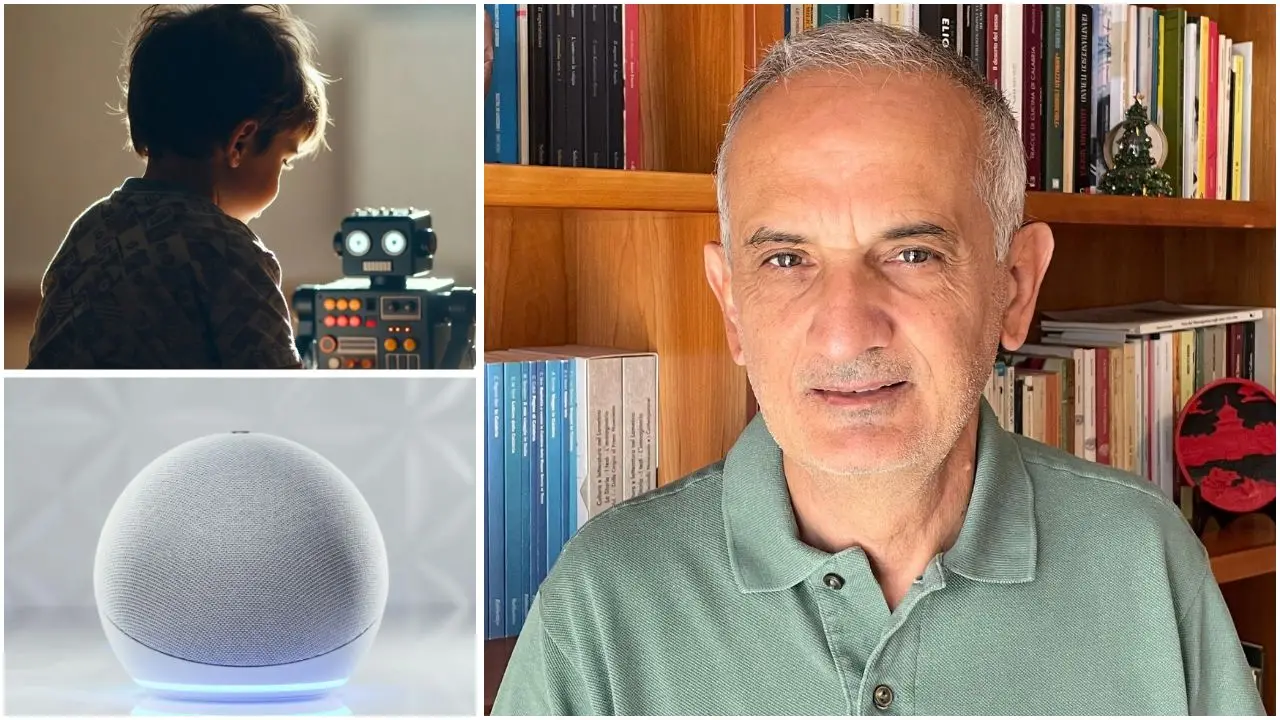

Tra dispositivi e giocattoli “smart” che elaborano richieste inappropriate, l’IoT espone utenti e minori a nuovi rischi. Il docente del corso di Ingegneria Informatica avverte: «Nessuno è preparato a questa rivoluzione e c’è un problema culturale. I bambini portano a casa oggetti sofisticati e insegnano ai genitori...»

Tutti gli articoli di Società

PHOTO

Ci spiano, ci controllano, influenzano pensieri e azioni dei nostri figli. Eppure non ne possiamo fare a meno, perché ci semplificano la vita e ci permettono di gestire in maniera più efficiente ed ottimizzata la nostra quotidianità. L’internet delle cose (IoT) – l’insieme di tutti quegli oggetti che incorporano al proprio interno sistemi di intelligenza artificiale in grado di interagire con l’uomo, dunque giocattoli, elettrodomestici, accessori personali, dispositivi come Alexa – porta, però, con sé questioni etiche dirimenti sulla presenza dell’IA nella nostra vita, trasformando radicalmente i concetti di privacy e sicurezza digitale.

Una rivoluzione che, secondo il professor Domenico Talia, docente di Sistemi Operativi e di Sistemi Cloud, Distribuiti e High Performance Computing al corso di laurea in Ingegneria Informatica dell’Università della Calabria, «è arrivata troppo velocemente perché la società potesse prepararsi».

Privacy e turbocapitalismo: «Paghiamo i servizi con i nostri dati»

Ai nostri microfoni Talia ricorda come, agli inizi, la preoccupazione per la sicurezza fosse quasi assente: «Si usavano protocolli non cifrati, password deboli, sistemi facilmente violabili. Di quella leggerezza paghiamo ancora oggi le conseguenze». Ora l’attenzione è cresciuta, ma esistono ancora moltissimi dispositivi che possono essere violati con facilità: «Quando clicchiamo “accetto”, di fatto, accettiamo sì di rispettare il GDPR, ma finiamo anche per acconsentire l’intrusione di questi sistemi nelle nostre vite».

Questo, secondo Talia, è un nodo cruciale: «La gratuità di tali servizi ci convince a barattare la nostra privacy con la possibilità di usufruirne. È un modello profondamente capitalista, che ci porta a cedere informazioni senza reale consapevolezza». Una dinamica resa più pericolosa dal fatto che questi oggetti sono inseriti in modo pervasivo negli ambienti domestici: «Sono nelle nostre tasche, nelle nostre case, accanto ai nostri bambini», osserva.

Inoltre, stabilire chi sia responsabile delle decisioni prese da un dispositivo “intelligente” resta un tema complesso. «Non può esserlo l’algoritmo, perché non ha personalità giuridica. Le responsabilità possono ricadere su chi lo sviluppa, su chi lo commercializza, su chi lo vende. Ma oggi non esiste ancora un quadro normativo che riesca davvero a gestire questa complessità e la velocità con cui cambia ormai a cadenza giornaliera».

L’AI Act europeo, ricorda il docente, introduce una classificazione dei livelli di rischio e limitazioni sui sistemi ad alto rischio, ma la sua piena applicazione è in ritardo: «La Commissione europea sta valutando di posticiparne ulteriormente l’entrata in vigore. Le aziende, dal canto loro, non sempre vedono di buon occhio questi vincoli. Etica, così, diviene un concetto ambiguo».

Giocattoli “smart” e minori: «Una situazione critica, siamo nel Far West tecnologico»

A proposito di sistemi ad alto rischio, recenti inchieste giornalistiche hanno denunciato il caso di giocattoli connessi – alcuni dei quali poi ritirati dal mercato - in grado di fornire ai bambini informazioni inappropriate – imbastendo con loro conversazioni su pratiche o feticismi sessuali - o pericolose per la loro incolumità e quella della loro famiglia, dando - ad esempio - le istruzioni su come accendere il fuoco con un fiammifero o su dove trovare i coltelli. Un serio campanello d’allarme.

«Questi episodi mostrano quanto siamo vulnerabili», commenta Talia. «Non c’è ancora un quadro legislativo capace di proteggere efficacemente i minori, né in Europa né negli Stati Uniti. Alcuni Paesi stanno provando ad adottare alcune misure, come il possibile divieto in Australia dell'uso dei social ai minori di 16 anni. Ma siamo ancora molto lontani da un controllo adeguato a 360 gradi».

«Serve educazione digitale fin dalle elementari»

Per Talia, il nodo è soprattutto culturale ed educativo: «Non possiamo pensare che il problema si risolva da solo. Serve un’educazione digitale strutturata, già dalle scuole elementari. I ragazzi capiscono, se vengono informati. Ma oggi seguono la corrente, perché nessuno fornisce loro strumenti adeguati».

Anche le famiglie, secondo il professore, spesso non sono preparate: «La televisione ne parla pochissimo. I bambini portano in casa dispositivi sofisticati e sono loro a insegnare agli adulti a usarli, senza però capirne i rischi. L’apparente semplicità di questi oggetti nasconde una complessità enorme, progettata per essere invisibile».

La responsabilità, dice, è condivisa: scuola, famiglie, istituzioni, media, legislatori, università. «Siamo nel mezzo di una trasformazione rapidissima e dagli investimenti economici mai visti. Senza una risposta coordinata, la società non riuscirà a gestirla».

Ricerca ed etica all’Unical: «Chi sviluppa tecnologia deve avere principi solidi»

Al corso di Ingegneria Informatica dell’Unical, l’etica è già parte integrante della formazione: «Da alcuni anni abbiamo introdotto un corso di etica del digitale nel nostro curriculum. È essenziale che chi progetta questi sistemi abbia ben chiaro l’impatto delle proprie scelte».

Sul versante della ricerca, il dipartimento lavora su vari fronti: intelligenza artificiale sostenibile, risparmio energetico, sicurezza dei sistemi, valutazione del rischio. «Studiamo quanto questi dispositivi possano minacciare gli utenti e quali tecnologie servano per ridurre tale rischio».

La tecnologia, afferma Talia, offre già soluzioni per progettare sistemi etici e sicuri fin dall’inizio. «Si parla di privacy by design, security by design: sono approcci tecnici esistenti e pienamente realizzabili. Il problema è convincere – o obbligare – le aziende ad adottarli. Spesso costano di più, o riducono la possibilità di sfruttare i dati degli utenti».

La società, però, può giocare un ruolo decisivo: «Gli utenti devono informarsi, chiedere, non accettare tutto passivamente. L’opinione pubblica ha un grande potere di pressione sulle aziende. E deve usarlo».